OpenClaw(原Moltbot、Clawdbot)Web页面集成

通过阿里云应用连接器(AppFlow)可以将 OpenClaw服务与Web页面集成,实现在页面中,通过自然语言直接与OpenClaw交互。计费说明在轻量应用服务器上部署并使用OpenClaw服务将产生以下费用:轻量应用服务器费用:参见轻量应用服务器计费概述。模型调用费用:OpenClaw执行过程中默认调用百炼模型。模型调用的主要计费方式有两种

2026-03-10

浏览:1000+

OpenClaw(原Moltbot、Clawdbot)企业微信集成

本文介绍将OpenClaw服务与企业微信集成,实现在群聊中,通过自然语言直接与OpenClaw交互。计费说明在轻量应用服务器上部署并使用OpenClaw服务将产生以下费用:轻量应用服务器费用:参见轻量应用服务器计费概述。模型调用费用:OpenClaw执行过程中默认调用百炼模型。模型调用的主要计费方式有两种:Coding PlanAI 编码

2026-03-10

浏览:1000+

OpenClaw(原Moltbot、Clawdbot)集成飞书

本文介绍将 OpenClaw服务与飞书集成,实现在飞书群聊或单聊中,通过自然语言直接与OpenClaw交互。计费说明在轻量应用服务器上部署并使用OpenClaw服务将产生以下费用:轻量应用服务器费用:参见轻量应用服务器计费概述。模型调用费用:OpenClaw执行过程中默认调用百炼模型。模型调用的主要计费方式有两种:Coding Plan

2026-03-09

浏览:1000+

通过OpenClaw(原Moltbot、Clawdbot)调用IMessage

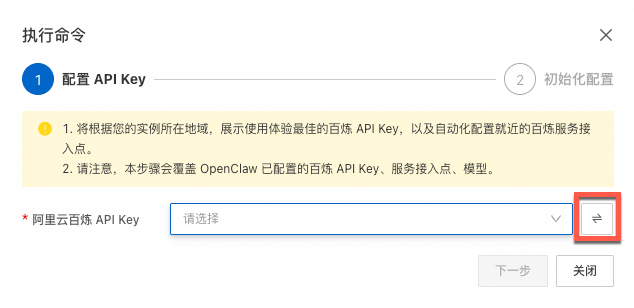

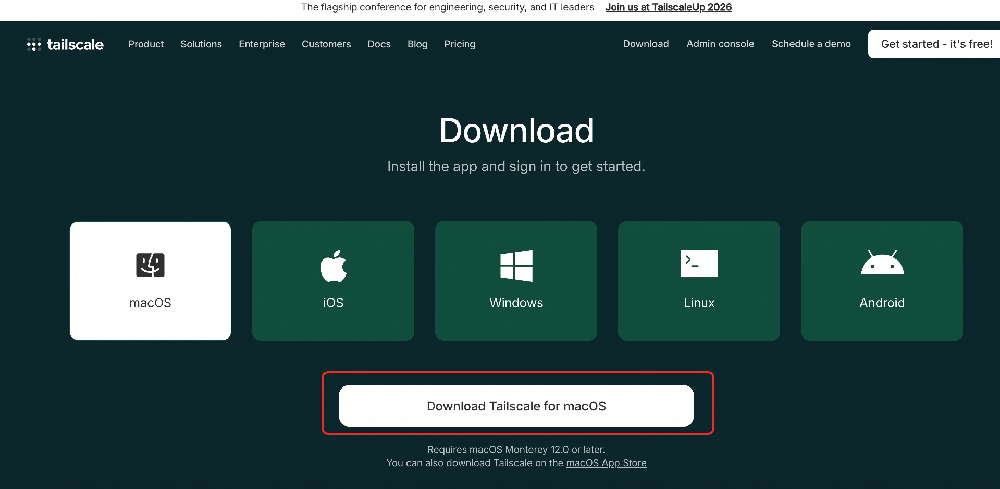

基于 Linux 部署 OpenClaw 网关,通过 Tailscale 构建安全隧道互联 Mac,实现通过OpenClaw管理Mac上的iMessage。架构┌──────────────────────────────┐SSH(imsgrpc)&

2026-03-09

浏览:1000+

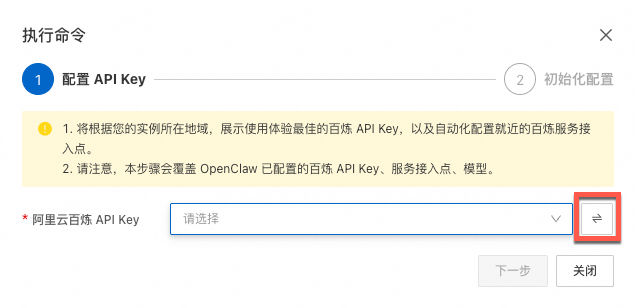

部署OpenClaw(原Moltbot、Clawdbot)镜像

OpenClaw是一款开源的本地优先AI代理与自动化平台。可通过OpenClaw将多渠道通信能力与大语言模型深度集成,创建拥有持久记忆与主动执行能力的定制化 AI 助理。重要OpenClaw 为开源 AI 助手,请在使用前充分评估其安全性与稳定性并严格遵循许可协议,以切实保障系统环境与数据安全。视频教程-快速部署 OpenClaw并集成钉钉为了

2026-03-09

浏览:1000+

DDoS原生防护和Web应用防火墙组合使用方案

本文介绍了为网站类业务同时部署DDoS原生防护和Web应用防火墙的配置方法。该方案适用于为网站业务同时防御四层DDoS攻击和七层Web攻击、CC攻击的场景。前提条件已创建ECS实例并部署了业务相关的应用,ECS实例拥有公网IP地址且网站有域名。说明如果网站用于在中国内地提供服务,则网站域名必须已经完成ICP备案,否则将不能接入

2026-02-28

浏览:1000+

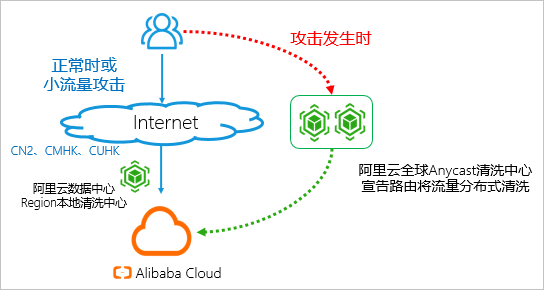

DDoS原生防护代播模式攻击时自动启用配置

本文介绍了使用DDoS原生防护代播模式自动防御大流量DDoS攻击的最佳实践,适用于已经开通了DDoS原生防护代播模式的用户在阿里云IP资产受到攻击时,通过API接口自动启用DDoS原生防护代播模式的场景。前提条件已购买DDoS原生防护实例。更多信息,请参见购买DDoS原生防护实例。已联系销售人员购买了DDoS原生防护代播版实例。已在

2026-02-28

浏览:1000+

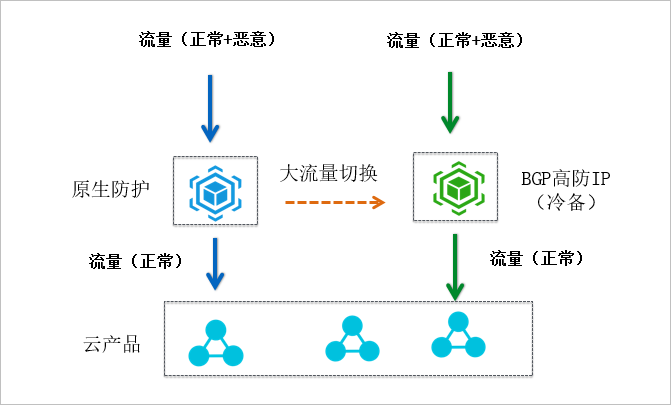

同时部署DDoS原生防护和DDoS高防(中国内地)

同时部署DDoS原生防护和DDoS高防(中国内地)时,您可以同时享受两者的优势,DDoS原生防护的费用可控、全资产防护、透明部署无延迟,以及DDoS高防的超大攻击流量防护。本文介绍如何为业务同时部署DDoS原生防护和DDoS高防(中国内地)。流量切换说明当DDoS攻击不超过原生防护的防御能力时(防御能力具体和所在地域有关,详细

2026-02-28

浏览:1000+

黑洞自动解除最佳实践

已经添加到DDoS原生防护进行防护的公网IP资产遭受瞬时超大流量DDoS攻击时仍可能被黑洞,需要对被黑洞的IP快速执行黑洞解除操作恢复业务,保障业务稳定性。针对该场景,DDoS原生防护提供了黑洞自动化响应和快速解除的解决方案。前提条件黑洞自动化响应和快速解除解决方案需要调用DDoS原生防护的API接口,目前该解决方案仅支持

2026-02-27

浏览:1000+

升级使用DDoS高防服务

由于DDoS原生防护服务的架构限制,在某些特定情况下,DDoS原生防护提供的安全防护能力可能无法完全满足您的DDoS防护需求。如果DDoS原生防护已无法满足您的安全防护需求,建议您升级使用DDoS高防服务,提升安全防护能力。背景信息关于DDoS原生防护适用的安全防护场景,请参见应用场景。如果您已购买DDoS原生防护实例,在实际

2026-02-27

浏览:1000+