安装并使用DeepGPU-LLM

在处理大语言模型(LLM)任务中,您可以根据实际业务部署情况,选择在不同环境(例如GPU云服务器环境或Docker环境)下安装推理引擎DeepGPU-LLM,然后通过使用DeepGPU-LLM实现大语言模型(例如Llama模型、ChatGLM模型、百川Baichuan模型或通义千问Qwen模型)在GPU上的高性能推理优化功能。说明LLM模型的特性适用于GPU计算型实

2025-07-07

浏览:1000+

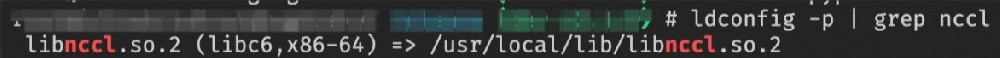

安装并使用DeepNCCL

DeepNCCL是阿里云神龙异构产品开发的用于多GPU互联的AI通信加速库,能够无感地加速基于NCCL进行通信算子调用的分布式训练或多卡推理等任务。开发人员可以根据实际业务情况,在不同的GPU云服务器上安装DeepNCCL通信库,以加速分布式训练或推理性能。本文主要介绍在Ubuntu或CentOS操作系统的GPU实例上安装和使用DeepNCCL的操作

2025-07-07

浏览:1000+

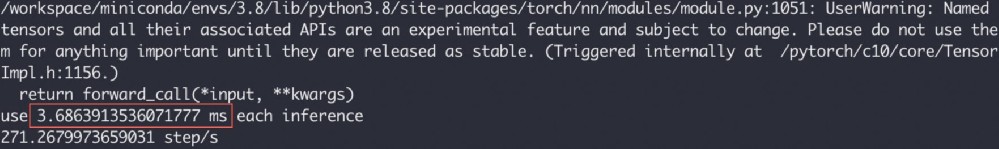

安装和使用Deepytorch Inference

Deepytorch Inference是阿里云自研的AI推理加速器,针对Torch模型,可提供显著的推理加速能力。本文主要介绍安装并使用Deepytorch Inference的操作方法,以及推理效果展示。背景信息Deepytorch Inference通过调用deepytorch_inference.compile(model)接口即可实现推理性能加速。使用DeepytorchInference前,您需要先使

2025-06-27

浏览:1000+

安装和使用Deepytorch Training

Deepytorch Training是阿里云自研的AI加速器,面向传统AI和生成式AI场景,在模型训练过程中,可提供显著的训练加速能力。本文主要介绍安装并使用Deepytorch Training的操作方法。说明关于Deepytorch Training的更多信息,请参见什么是Deepytorch Training(训练加速)。前提条件已创建阿里云GPU实例,且GPU实例需满足以下要

2025-06-27

浏览:1000+

使用RAM进行GPU产品的访问控制

为确保您的阿里云账号及云资源使用安全,如非必要,都应避免直接使用阿里云账号(即主账号)来访问GPU云服务器,推荐的做法是使用RAM身份(即RAM用户和RAM角色)并授予权限策略来进行权限管理,可有效控制资源的访问安全。GPU云服务器使用RAM进行访问控制时,其身份管理、权限策略以及服务关联角色与云服务器ECS一致,具体说

2025-06-27

浏览:1000+

基于异构机密计算实例构建安全大语言模型推理环境

随着大语言模型技术的普及,企业对推理过程中的数据安全问题日益关注。本文将介绍如何基于阿里云异构机密计算实例及Confidential AI方案(以下简称CAI),快速构建安全的大语言模型推理环境。背景说明阿里云异构机密计算实例(gn8v-tee)在CPU TDX机密计算实例的基础上,额外将GPU引入到TEE(Trusted Execution Environment

2025-06-26

浏览:1000+

使用SD-WebUI容器镜像加速文生图

对于需要文生图的业务场景,通过使用Stable Diffusion模型可以实现文生图功能。相比未使用DeepGPU加速的情况,借助DeepGPU可以加速Stable Diffusion模型的计算和推理性能。例如,文本生成分辨率为512x512图像的情况下,使用DeepGPU功能其加速性能可能提升约88%。本文为您介绍如何在GPU实例上部署SD-WebUI容器镜像以加速文生

2025-06-26

浏览:1000+

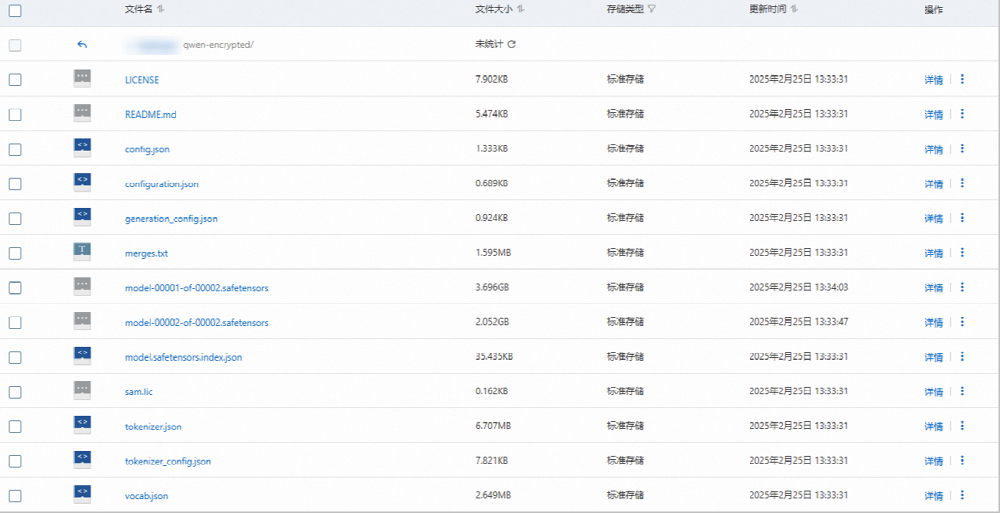

使用vLLM镜像快速构建模型的推理环境

在GPU的实例上部署vLLM镜像后,可以帮助您快速且方便地构建大语言模型(例如Llama模型、ChatGLM模型、百川Baichuan模型或通义千问Qwen模型)的推理环境,主要应用在智能对话系统、文本分类或分析等自然语言处理业务场景,您无需深入了解底层硬件,也无需额外配置即可开箱即用。本文为您介绍如何在GPU实例上使用vLLM容器镜像

2025-06-26

浏览:1000+

使用DeepGPU-LLM镜像构建模型的推理环境

在GPU实例上配置DeepGPU-LLM容器镜像后,可以帮助您快速构建大语言模型(例如Llama模型、ChatGLM模型、百川Baichuan模型或通义千问Qwen模型)的推理环境,主要应用在智能对话系统、文本分析、编程辅助等自然语言处理业务场景,您无需深入了解底层的硬件优化细节,镜像拉取完成后,无需额外配置即可开箱即用。本文为您介绍如

2025-06-25

浏览:1000+

使用TensorRT-LLM构建模型的推理环境

在GPU的实例上安装推理引擎TensorRT-LLM,可以帮助您快速且方便地构建大语言模型(例如Llama模型、ChatGLM模型、百川Baichuan模型或通义千问Qwen模型)的推理环境,主要应用在智能对话系统、文本分析等自然语言处理业务场景。本文为您介绍如何在GPU实例上安装和使用TensorRT-LLM来快速构建大语言模型的高性能推理优化功能。

2025-06-25

浏览:1000+